Commençons par un bref historique de la photo sur cette vidéo:

Revenons un petit peu en arrière à l’époque du Noir et Blanc:

Bien entendu, le codage en noir et blanc ne donne pas des images de bonne qualité !

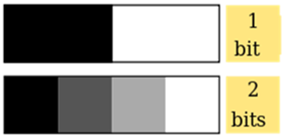

On appelle profondeur de couleur le nombre de bits utilisés pour coder la couleur d’un pixel. Pour une image en noir et blanc, la profondeur est de 2 bits. Cela ne suffit pas pour donner une image correcte d’un ensemble complexe : en fait, la photographie en « noir et banc », n’est pas codée en noir et banc, mais en nuances de gris.

Ces 2 images correspondent à une même prise de vue, mais l’une est en noir et blanc (image en noir et blanc) et l’autre en nuances de gris (= image monochrome)

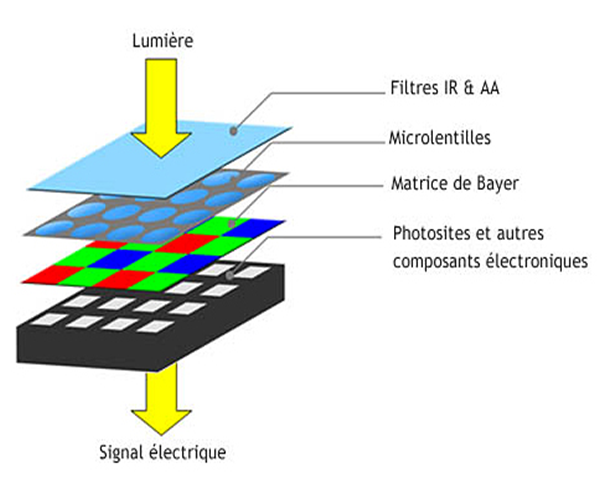

Un capteur photographique (dans un appareil photo ou un smartphone) contient des photosites : il s’agit de composants électroniques qui convertissent l’énergie lumineuse en tension électrique. Les tensions électriques seront converties en valeurs numériques par l’ordinateur afin de reconstituer les pixels.

A faire vous-même 1: codage en niveau de gris

Dans les travaux précédents, vous avez utilisé des images en noir et blanc : chaque pixel était encodé sur 1 bit. Pour avoir des nuances de gris, il est nécessaire d’avoir un encodage plus complexe utilisant davantage de bits pour un pixel. Par exemple, chaque bit pouvant prendre 2 valeurs, avec 2 bits, on peut obtenir 4 nuances.

En général, pour une image monochrome, la profondeur de couleur est de 8 bits : combien de nuances de gris sont possibles ?

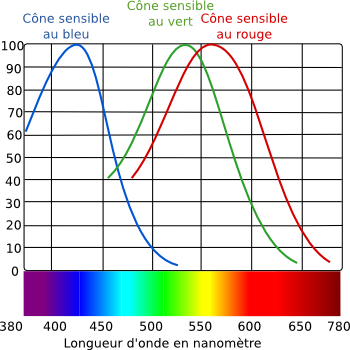

Une photographie en couleur rendra encore mieux la réalité. Dans l’œil humain, la rétine contient des cellules sensibles au changement de luminosité (les bâtonnets) et des cellules sensibles à des radiations particulières de la lumière : les cônes. Il existe 3 types de cônes : ceux qui sont sensibles aux radiations bleues, ceux qui sont sensibles au vert et ceux qui captent plutôt les rouges. Grâce à ces 3 types de cônes, on peut voir toutes les couleurs par synthèse additive.

Ces 3 couleurs de lumière sont dites primaires.

Pour obtenir une photographie en couleurs, il y a devant le capteur photographique des filtres colorés comme la matrice Bayer RVB (Rouge, Vert, Bleu). On utilise donc un codage en Rouge/Vert/bleu.

La matrice Bayer est composée de 50 % de filtres verts (car l’œil humain est capable de distinguer de très nombreuses nuances de verts), 25 % de filtres rouges et autant de bleus.

Il existe différents types de filtres (voir https://geometrian.com/programming/reference/subpixelzoo/index.php) qui permettent tous de capter pour chaque pixel, la luminance en rouge, vert et bleu.

Un pixel sera donc composé des informations en luminance des photosites par synthèse additive des couleurs primaires R, V, B

Expliquez en quoi consiste la synthèse additive (si besoin, faites une recherche)

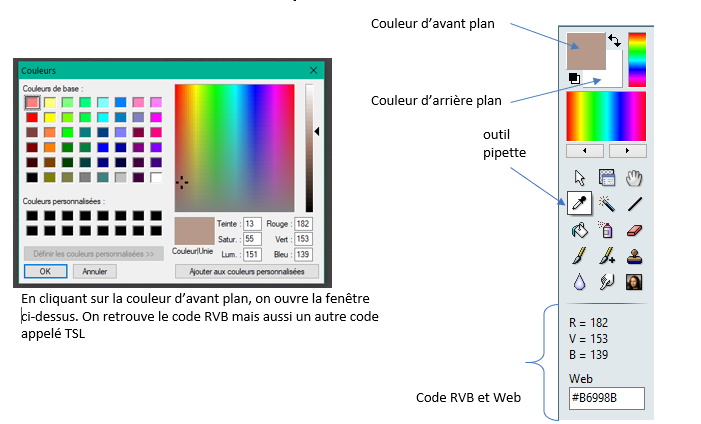

On codera donc un pixel à l’aide d’un triplet de valeurs (par exemple 247, 56, 98). La première valeur donnant l’intensité du canal rouge, la deuxième valeur donnant l’intensité du canal vert et la troisième valeur donnant l’intensité du canal bleu (RVB ou RGB en anglais).

Expliquez pourquoi, pour chaque canal de chaque pixel, l’intensité lumineuse est comprise entre 0 et 255.

Si chaque canal est codé avec 8 bits, quelle est la profondeur de couleur ?

Combien de couleurs différentes sont-elles possibles avec une telle profondeur ?

A faire vous-même 2

Lancez le logiciel photofiltre puis ouvrez l’image souris.jpeg

Avec l’outil pipette (copie d’écran), prélevez différentes couleurs et donnez les codes correspondants en RVB.

A faire vous-même 3

Menu Réglage > négatif

Que deviennent les différentes couleurs ?

Donnez les codes RVB correspondants.

A faire vous-même 4

A l’aide de l’outil Pixies à lancer ici, relevez le code RVB de la couleur sélectionnée en avant plan.

https://icn-isn-boissy.yj.fr/wp/wp-content/uploads/2020/02/pixie.zip

Calculez la couleur qu’on obtiendrait avec le réglage négatif réalisé dans le « à faire vous-même 3 ». Quel nom pourrait-on lui donner ?